AI资讯

智元启元 GO-1 大模型升级:具身智能助力 AIGC 内容生成效率

2025-07-16

0次阅读

🔥 智元启元 GO-1 大模型升级:具身智能如何重塑 AIGC 内容生成范式

在人工智能领域,每一次技术突破都可能带来行业的革新。智元启元 GO-1 大模型的升级,正是这样一个具有里程碑意义的事件。这次升级的核心在于具身智能的引入,它让 AIGC(人工智能生成内容)的效率提升到了一个新的高度。

具身智能,简单来说,就是让人工智能不仅拥有 “大脑”,还拥有 “身体”,能够感知和理解物理世界,并通过行动与之交互。这一概念的提出,彻底改变了传统 AIGC 只停留在虚拟世界的局限。GO-1 大模型通过具身智能,实现了从 “感知 - 理解 - 决策 - 执行” 的全流程闭环,让 AIGC 内容生成更加贴合实际场景,效率也大幅提升。

那么,具身智能是如何助力 AIGC 内容生成的呢?首先,它解决了传统 AIGC 数据采集的难题。以往,机器人学习一个简单的动作,比如倒水,可能需要采集上万条数据。而 GO-1 大模型通过具身智能,只需采集一千条数据就能让机器人学会这个动作。这是因为具身智能让模型能够利用人类视频和跨本体操作数据进行学习,大大降低了对真机数据的依赖。

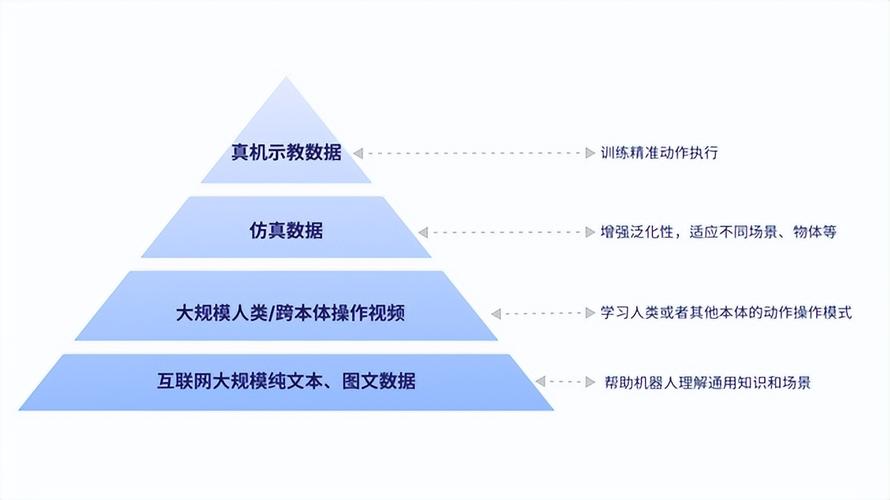

具体来说,GO-1 大模型采用了 Vision-Language-Latent-Action(ViLLA)架构。这个架构由 VLM(多模态大模型)和 MoE(混合专家)组成。VLM 借助海量互联网图文数据获得通用场景感知和语言理解能力,MoE 中的 Latent Planner(隐式规划器)通过大量跨本体和人类操作视频数据获得通用的动作理解能力,Action Expert(动作专家)则借助百万真机数据获得精细的动作执行能力。三者协同工作,让模型能够快速理解任务要求,并生成精准的动作序列。

以挂衣服这个任务为例,GO-1 大模型的工作流程是这样的:首先,通过互联网的图文数据理解 “挂衣服” 的含义;然后,学习人类操作视频和其他机器人的操作视频,了解挂衣服的步骤;接着,在仿真数据中模拟不同衣服、衣柜和房间的场景;最后,通过真人示教数据精准完成挂衣服的操作。整个过程一气呵成,体现了具身智能在复杂任务处理中的强大能力。

具身智能的引入,让 GO-1 大模型在 AIGC 内容生成中展现出了多方面的优势。在工业制造领域,它可以实现自动化的质检和装配,提高生产效率;在物流配送中,能够优化路径规划,降低成本;在家庭服务方面,还能完成各种家务劳动,提升生活品质。这些应用场景的拓展,不仅让 AIGC 内容生成更加多样化,也让其在实际应用中的价值得到了充分体现。

从行业发展的角度来看,GO-1 大模型的升级标志着具身智能向通用化、开放化、智能化方向迈出了重要一步。随着数据采集技术的不断进步和模型的持续进化,具身智能在 AIGC 中的应用前景将更加广阔。未来,我们有理由相信,具身智能将成为推动 AIGC 发展的核心动力,为我们带来更多惊喜。

该文章由 dudu123.com 嘟嘟 AI 导航整理,嘟嘟 AI 导航汇集全网优质网址资源和最新优质 AI 工具。

用户评论 (0)

暂无评论,快来发表第一条评论吧!