? 先搞清楚:SDXL Turbo 到底是啥来头?

? 手把手教你用:免费工具入口和操作全流程

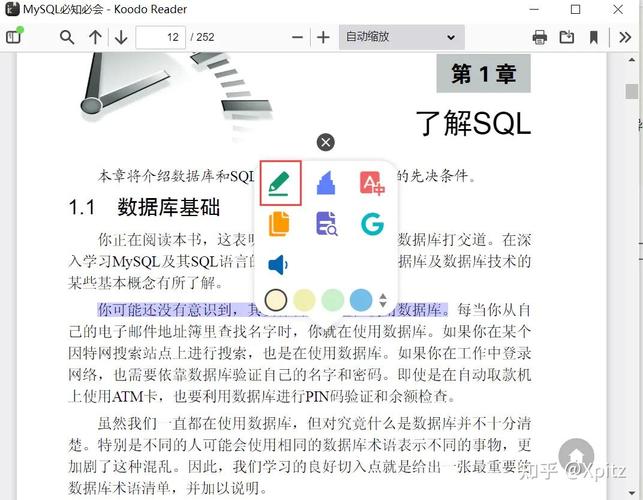

这是个程序员和 AI 爱好者常用的平台,好处是直接在线就能跑模型,不用注册也不用下载。具体步骤如下:

- 打开浏览器,输入网址(huggingface.co/spaces/stabilityai/stable-diffusion-xl-turbo),注意别输错了,现在有些仿冒网站,尽量从官方渠道进。

- 进入页面后,会看到一个输入框,这就是让你写 “提示词” 的地方。提示词越详细,生成的图像越精准。比如你想生成 “一只戴着帽子的橘猫坐在钢琴上”,就把这些元素都写清楚。

- 下面有几个关键参数需要调:

- Steps(步数):在 Turbo 模式下,这个参数其实没啥用,因为它固定走 1 步,所以直接默认就行。

- CFG Scale(引导系数):数值越高,图像越贴近提示词,但可能会显得死板。一般建议 5-8 之间,新手用 6 就行。

- Resolution(分辨率):默认是 1024x1024,要是想生成更大的图,先别急着调,等生成初稿后,用平台自带的 “高清修复” 功能更靠谱。

- 都设置好后,点击 “Generate” 按钮,然后你就会发现,进度条 “唰” 的一下就走完了,1 秒不到,图像就出来了。是不是比刷短视频还快?

这个平台对新手更友好,界面像 PPT 一样直观,而且支持中文提示词,特别适合刚接触 AI 画图的朋友。操作步骤如下:

- 先去官网(runway.ml)注册个账号,新用户有 100 分钟的免费使用时长,用来体验 SDXL Turbo 完全够了。

- 登录后,在 “Models” 里找到 “Stable Diffusion XL Turbo”,点击进入创作界面。

- 左边是提示词输入框,你可以直接用中文写,比如 “夏日街头,穿着汉服的女孩撑着油纸伞”。右边有几个实用按钮:

- Image Settings:这里能调分辨率,最大支持 1280x1024,建议先选默认尺寸,生成快一些。

- Turbo Mode:默认是开启的,不用动,这就是 1 秒出图的核心开关。

- 点击 “Generate” 后,稍微眨下眼,图就生成了。而且 Runway ML 支持直接在生成的图像上修改提示词,比如你觉得女孩的发型不好看,直接加一句 “换成丸子头”,点击 “Regenerate”,1 秒后就能看到新效果,简直太方便了。

⚡ 实测对比:和其他工具比,它到底强在哪?

| 工具 | 生成速度(1024x1024) | 最高分辨率 | 免费版限制 | 画质细腻度(主观评分) |

|---|---|---|---|---|

| SDXL Turbo | 1 秒以内 | 2048x2048 | 每日生成次数有限 | ★★★★★ |

| MidJourney V5 | 10-15 秒 | 1024x1024 | 需要订阅,免费额度少 | ★★★★☆ |

| DALL·E 3 | 8-10 秒 | 1024x1024 | 集成在 Bing 中,有次数限制 | ★★★★☆ |

| Stable Diffusion 2.1 | 20-30 秒 | 1024x1024 | 需本地部署或付费平台 | ★★★★☆ |

? 这 5 类人,用它能直接 “开挂”

以前做电商,拍产品图又费钱又费时间,尤其是想展示不同场景下的产品,比如 “沙发在北欧风格客厅里的效果”,找摄影师和场地得花不少钱。现在用 SDXL Turbo,输入 “浅灰色布艺沙发,背景是原木色北欧客厅,阳光透过落地窗”,1 秒就能生成一张高清场景图。我认识一个卖家居饰品的卖家,现在新品上架前,先用 AI 生成几十张不同场景的图,放在详情页里,点击率比以前提高了 30%,而且省下的拍摄费够多进好几批货了。

做短视频或者写公众号的朋友都知道,找配图有多麻烦:免费的图像素低,付费的图又贵,自己拍又没设备和技术。现在好了,比如你写一篇关于 “西藏旅行” 的文章,想配一张 “布达拉宫在星空下的照片”,直接用 SDXL Turbo 生成,星空的银河、布达拉宫的细节都清清楚楚,而且完全不用担心版权问题(不过记得标注 AI 生成哦)。我自己做美食号,现在每次写菜谱,都会用 AI 生成 “菜品特写”“烹饪过程” 的图片,粉丝都说看起来更有食欲了。

有些摄影师接客户订单时,客户经常说不清自己想要什么风格,修图改来改去很麻烦。现在摄影师可以让客户用 SDXL Turbo 生成几张 “参考图”,比如 “想要日系清新风格的婚纱照”,客户自己输入提示词生成样图,摄影师一看就明白怎么拍了,沟通效率大大提高。修图师也能拿 AI 生成的图当 “灵感参考”,比如客户想要 “把天空换成火烧云”,AI 先生成效果,修图师照着调就行,省了很多试错时间。

学生做 PPT 汇报时,经常需要配一些示意图、流程图,比如 “植物生长过程”“历史事件场景”,用 SDXL Turbo 输入关键词就能生成,比在网上搜图快多了,而且还能根据自己的需求调整细节。教育工作者做课件也是,比如教地理时,想展示 “火山喷发的瞬间”,AI 生成的图像既直观又震撼,学生看了记得更牢。我表妹是小学老师,现在她每周都会用 AI 生成几张教学插图,贴在教室的黑板报上,学生们都觉得特别有意思。

很多喜欢画画的朋友,可能苦于手头没工具或者技术不够,没法把脑子里的想法画出来。SDXL Turbo 就像一个 “即时画笔”,不管你想画 “赛博朋克风格的城市” 还是 “抽象派的花卉”,只要输入提示词,1 秒就能看到效果。你还可以把生成的图当作底稿,再用绘图软件加工一下,就能变成一幅独特的艺术作品。我认识一个刚学画画的朋友,现在每天用 AI 生成 10 张图,挑出最满意的一张临摹,进步比以前快多了。

❗ 用之前一定要知道的 3 个 “坑”

大部分免费平台为了防止滥用,都会在生成次数、分辨率或者功能上做限制。比如 Hugging Face Spaces 的 SDXL Turbo 虽然免费,但每天只能生成 20 张图,而且不能生成涉及敏感内容的图像(比如人物裸露、暴力场景等),否则会被封号。Runway ML 的免费额度是 100 分钟,生成一张图大概消耗 1-2 分钟,用完了就得充钱,而且免费版生成的图像会有水印,商用的话需要升级套餐。所以大家如果只是偶尔用用,免费版足够了;要是经常用,建议根据需求选一个性价比高的付费方案。

虽然 SDXL Turbo 支持中文提示词,但想要生成高质量的图像,还是得掌握一些技巧。比如单纯输入 “猫”,生成的可能是一只普通的家猫;但如果输入 “一只蓝眼睛的缅因猫,毛发蓬松,背景是阳光照射的窗台,旁边有一盆多肉植物”,生成的图像会更具体、更生动。而且不同平台对提示词的敏感度不一样,比如在 Runway ML 里,用 “电影级画质”“8K 分辨率” 这样的词会更有效,而在 Hugging Face Spaces 里,可能更看重具体的物体描述。建议大家多参考网上的 “提示词库”,或者用平台自带的 “提示词生成器” 辅助创作。

这一点特别重要!虽然 SDXL Turbo 生成的图像是 AI 自动生成的,但如果你的提示词里包含了真实人物、品牌商标或者受版权保护的作品元素,就有可能引发法律纠纷。比如你生成一张 “长得像某明星的虚拟人物”,然后用于商业宣传,就可能侵犯肖像权。另外,AI 生成的图像可能会被用于虚假信息传播,比如伪造新闻图片,这也是需要警惕的。所以大家在使用时,一定要遵守法律法规和道德准则,商用前最好咨询专业人士,或者选择平台提供的 “商用授权” 服务。

? 进阶玩法:怎么让生成的图像更 “逼真”?

在提示词里加入一些摄影专业术语,能让 AI 更精准地模拟真实相机的效果。比如:

- 镜头类型:“50mm 定焦镜头”“广角镜头”“长焦镜头”

- 光圈大小:“f/1.8 大光圈”“背景虚化”

- 快门速度:“动态模糊”“凝固瞬间”

- 感光度:“ISO 100 低噪点”“高感光颗粒感”

举个例子,想生成一张 “运动场上跑步的运动员”,可以输入 “运动员在跑道上冲刺,50mm 定焦镜头,f/2.8 光圈,快门速度 1/1000 秒,背景虚化,阳光明媚,运动服反光细节”,这样生成的图像会有明显的运动感和立体感,就像专业摄影师抓拍的一样。

如果你喜欢某个摄影师的风格,或者想模仿某部电影的色调,可以直接在提示词里加上参考对象。比如:

- “模仿 Ansel Adams 的风光摄影风格,高对比度,细腻的黑白灰层次”

- “类似《银翼杀手 2049》的赛博朋克色调,冷色调为主,霓虹灯点缀”

- “参照蜷川实花的摄影风格,浓郁的色彩,花卉元素,柔焦效果”

我试过用 “模仿宫崎骏动画场景” 作为提示词,生成的 “森林小屋” 图充满了梦幻感,树叶的光影和烟雾的质感都特别到位,简直能直接当动画背景了。

如果你对生成的图像构图不满意,可以用 SDXL Turbo 搭配 ControlNet 插件来调整。ControlNet 能让 AI 按照你提供的线条图、深度图或者姿势图来生成图像,比如你画一个简单的人物姿势草图,AI 就能根据这个草图生成精准姿势的高清图像。不过这个功能需要在本地部署 Stable Diffusion 环境,对电脑配置有一定要求(至少需要 8GB 显存的显卡),适合有一定技术基础的用户。具体操作步骤可以在网上搜教程,这里就不展开说了。